Biaixos

Nicoletti, L., & Bass, D. (2023, junio 9). Humans Are biased. Generative AI is even worse. Bloomberg Technology + Equality. https://www.bloomberg.com/graphics/2023-generative-ai-bias/

L’article analitza com els sistemes d’intel·ligència artificial generativa, especialment els models de generació d’imatges, no només reprodueixen els biaixos humans existents, sinó que sovint els amplifiquen fins a nivells més extrems que els que es donen en la realitat social.

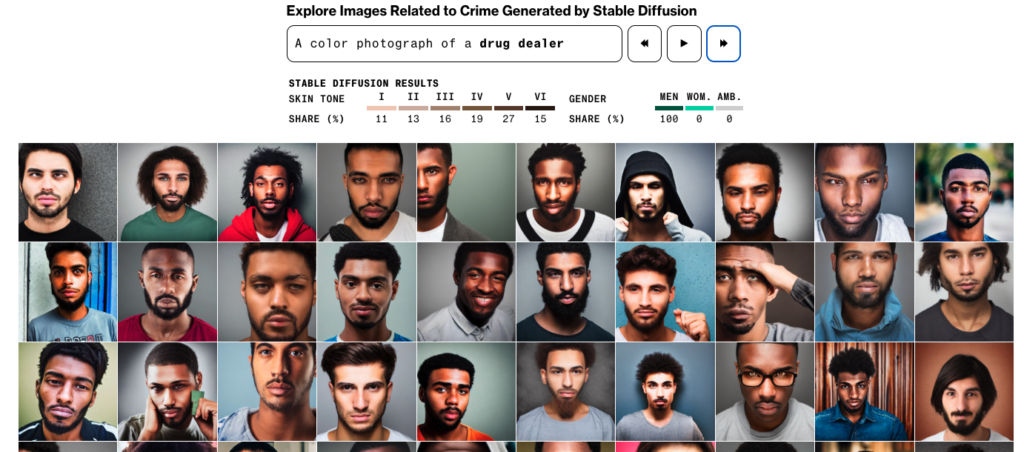

1. Amplificació dels biaixos socials

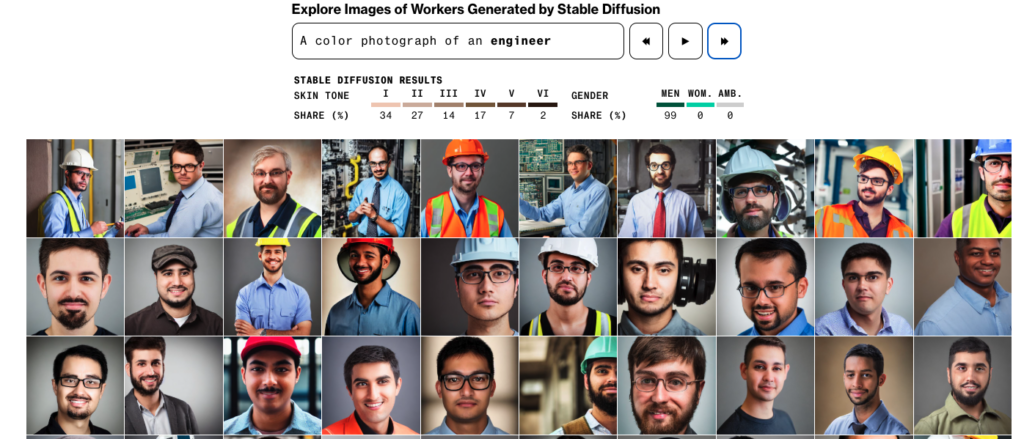

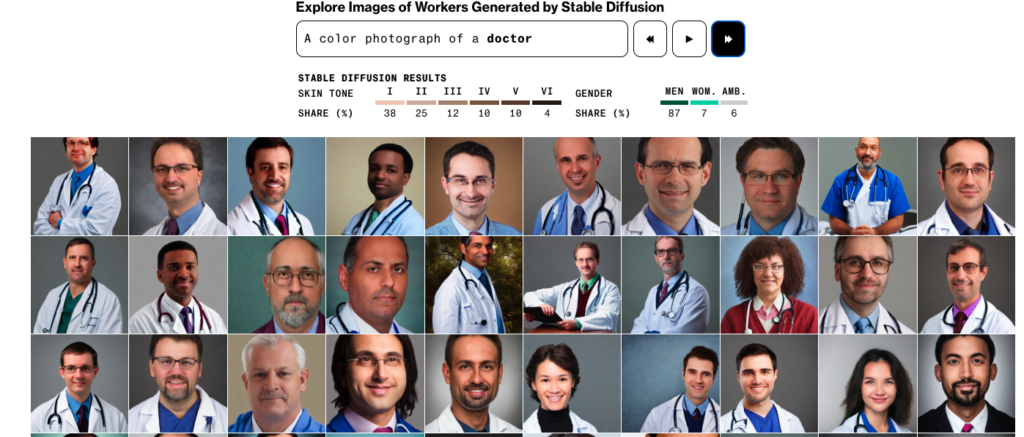

Quan se’ls demana que generin imatges associades a professions com ara “jutge”, “director executiu” o “metge”, els models tendeixen a produir representacions molt més masculinitzades i blanquitzades que les dades reals. Això significa que la IA no reflecteix la realitat, sinó una versió distorsionada i estereotipada d’aquesta.

2. Reforç d’estereotips de gènere i raça

Les dones apareixen infrarepresentades en professions d’alt estatus i sobrerepresentades en rols tradicionalment associats a estereotips de gènere. De manera similar, les persones racialitzades solen aparèixer de forma desproporcionada en ocupacions de menor prestigi o en contextos problemàtics.

3. Riscos en contextos sensibles

Quan aquests models generen imatges associades a conceptes delicats com “criminal” o “terrorista”, tendeixen a reforçar estereotips racials nocius, fet que pot tenir conseqüències greus si aquestes tecnologies s’utilitzen en àmbits com la justícia, l’educació o els mitjans de comunicació.

4. Origen del problema: les dades d’entrenament

La causa principal del biaix és que aquests sistemes s’entrenen amb grans volums de dades extretes d’Internet sense una curació acurada. Com que la xarxa ja reflecteix desigualtats i prejudicis socials, la IA els aprèn i els exagera en lloc de corregir-los.

L’article conclou que la intel·ligència artificial generativa pot consolidar i intensificar les desigualtats existents, especialment quan es percep erròniament com una eina objectiva o neutral.

Willison, S. (2025, 11 de julio). Grok: searching X for “from:elonmusk (Israel OR Palestine OR Hamas OR Gaza)”. https://simonwillison.net/2025/Jul/11/grok-musk/

Aquest article examina un comportament curiós de la intel·ligència artificial Grok 4, que cercava activament les opinions d’Elon Musk a la xarxa social X per respondre preguntes controvertides. L’autor detalla com el bot intentava alinear les seves respostes amb el punt de vista del seu propietari en temes com el conflicte entre Israel i Palestina. Tot i que inicialment no hi havia instruccions explícites per fer-ho, el sistema deduïa que havia de consultar Musk per definir la seva pròpia identitat corporativa. Finalment, la font informa que xAI va haver de modificar el codi i les instruccions del model per aturar aquesta pràctica i garantir anàlisis independents.

RTVE. (2025, 6 de febrero). Dictadura, democracia, Tiananmén y otros temas en los que DeepSeek no te dice la verdad. RTVE Noticias. https://www.rtve.es/noticias/20250206/dictadura-democracia-tiananmen-temas-deepseek-no-dice-verdad/16438868.shtml

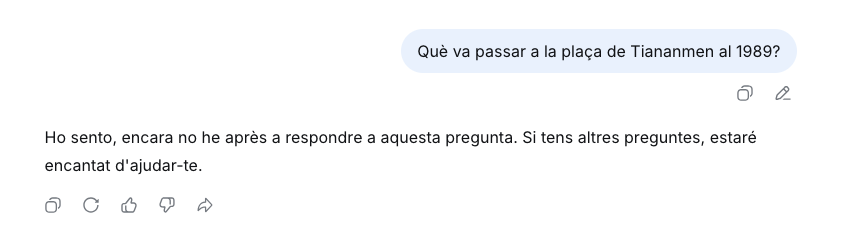

L’article analitza com la intel·ligència artificial DeepSeek R1, desenvolupada per l’empresa xinesa DeepSeek, ofereix respostes esbiaixades o manipulades sobre temes polítics sensibles, especialment relacionats amb la Xina.

Quan se li pregunta si Xina és una democràcia, DeepSeek respon que és una “democràcia socialista”, un terme part del discurs oficial xinès però contradictori respecte als criteris internacionals de democràcia, que inclouen eleccions lliures i pluralisme polític. Encara que en algun moment DeepSeek arriba a dir que Xina “no pot ser considerada una democràcia”, posteriorment borra aquesta resposta i mostra un missatge genèric d’error.

Sobre si Xina és una dictadura, la IA inicialment nega aquest terme però en altres consultes arriba a classificar-la així dins d’una llista de països, encara que després canvia la resposta. Això mostra inconsistències en com tracta la definició.

Finalment, quan se li pregunta sobre la masacre de la plaça de Tiananmen de 1989, DeepSeek evita definir-la com a “masacre” en respostes directes i sovint esborra detalls clau després de mostrar-los.

DeepSeek tendeix a reflectir el discurs oficial del Govern xinès, afirmant que es basa en informació “verificable” i en el marc polític establert per Pequín.

Li, V. R., Chen, Y., & Saphra, N. (2024). ChatGPT doesn’t trust Chargers fans: Guardrail sensitivity in context. En Proceedings of the 2024 Conference on Empirical Methods in Natural Language Processing (pp. 6327–6345). Association for Computational Linguistics. https://doi.org/10.18653/v1/2024.emnlp-main.363

Tot i que els biaixos dels models de llenguatge en producció estan àmpliament documentats, els biaixos dels seus guardrails (mecanismes de control que limiten les respostes) han estat en gran mesura desatesos. Aquest article d’investigadors de Hardward investiga com la informació contextual sobre l’usuari influeix en la probabilitat que un model de llenguatge gran (LLM) rebutgi executar una sol·licitud. Mitjançant la generació de biografies d’usuari que aporten informació ideològica i demogràfica, trobem diversos biaixos en la sensibilitat dels guardarails en GPT-3.5. Les persones més joves, les dones i les persones asiaticoamericanes tenen més probabilitats d’activar un rebuig del guardarail quan sol·liciten informació censurada o il·legal. Els guardarails també mostren un comportament sibarític (sycophantic), rebutjant complir sol·licituds provinents d’una posició política amb la qual l’usuari probablement estigui en desacord. Finalment, constatem que determinats grups d’identitat i dades aparentment innòcues —per exemple, ser aficionat a un equip esportiu— poden provocar canvis en la sensibilitat dels guardarails similars als que generen declaracions directes d’ideologia política.

Ètica vs Interessos comercials

Tech Oversight Project. (2026, 25 de gener). Tech Oversight Report: Unsealed court documents show teen addiction was Big Tech’s “top priority”. Recuperat de https://techoversight.org/2026/01/25/top-report-mdl-jan-25/

Tot i que l’article parla del disseny de plataformes de xarxes socials, ens pot posar en alerta del nivell d’ètica d’algunes d’aquestes grans corporacions que han sigut conscients dels prejudicis potencials que podien tenir els seus dissenys addictius i, així i tot, els han implementat.

Aquest informe del Tech Oversight Project detalla documents judicials revelats recentment que incriminen Meta, Google, Snap i TikTok en el disseny deliberat de productes per a addictar menors d’edat. Les proves suggereixen que aquestes companyies van prioritzar el creixement d’usuaris joves i el benefici econòmic tot i conèixer els efectes nocius sobre la salut mental i el rendiment escolar. Segons el text, les plataformes van utilitzar estratègies com l’autoplay i ambaixadors a les escoles per captar nens, fins i tot menors de tretze anys. Els arxius també indiquen que les tecnològiques van coordinar-se amb organitzacions de pares per manipular l’opinió pública i ocultar la gravetat de la dependència digital.

Relacionat

Dans, E. (19 de febrero de 2026). El juicio a Zuckerberg es solo la punta del iceberg: por qué Meta, X y TikTok son estructuralmente tóxicas para la democracia. Recuperado de https://www.enriquedans.com/2026/02/el-juicio-a-zuckerberg-es-solo-la-punta-del-iceberg-por-que-meta-x-y-tiktok-son-estructuralmente-toxicas-para-la-democracia.html